作为一名自高中起就一直使用「Apple 全家桶」的忠实 Google 粉丝,去年 Black Friday 折扣季我激情下单了自己的第一台「亲儿子」手机 —— Pixel 4 XL 。在使用了半年多后,今天想和大家聊一聊这台也许会成为「末代旗舰」的 Pixel 4 XL,在过去半年中的实际使用体验。

选择 Pixel 我得到了什么

依然记得去年一边摸鱼一边看的那场发布会,Google 在整场发布会中几乎没有花任何篇幅来介绍新款 Pixel 的外观、工业设计,连机身参数也是寥寥数语一笔带过。

这种「漫不经心」无形之中也给了我一种暗示,认为「Pixel 的核心卖点不是酷炫的外观/工业设计,不是顶级的硬件规格,而是一种独特的使用体验。」

时隔 10 个月,这段时间的使用经历为我当时的想法给出了肯定的回答。

参数并不能代表所有,Pixel 更像是一部由 Google 设计和创造的 iPhone。和早期的 iPhone 一样,若拿 Pixel 4 和同期的 Android 旗舰机型来比较硬件配置,无论是 SoC、运行内存、屏幕参数、相机传感器型号,还是手机本身颇具争议的设计2,它都不会是最出类拔萃的那一个;但要论实际使用体验,Pixel 4 却可能是使用起来最舒服的。

Pixel 4 系列的正面摒弃了前代巨大而丑陋的刘海,搭载了一块非异形、具备超高分辨率与 90Hz 高刷新率的 OLED 屏幕,这也是 Pixel 4 XL 身上我最喜爱的一点:高分辨率、高刷新率与广色域的特性使它具备了清晰锐利、色彩饱满、响应迅速的显示效果;同时 Google 也对 Android 10 系统动效的进一步改良、优化,配合更加符合物理定律的、恰到好处的加速度和过渡动画,手机系统中呈现的这个「小小世界」更加自然,让我即便在 10 个月后的今天也能时时感受到那种丝般顺滑的交互——不夸张地说,从开始使用至今我甚至不知卡顿为何物。

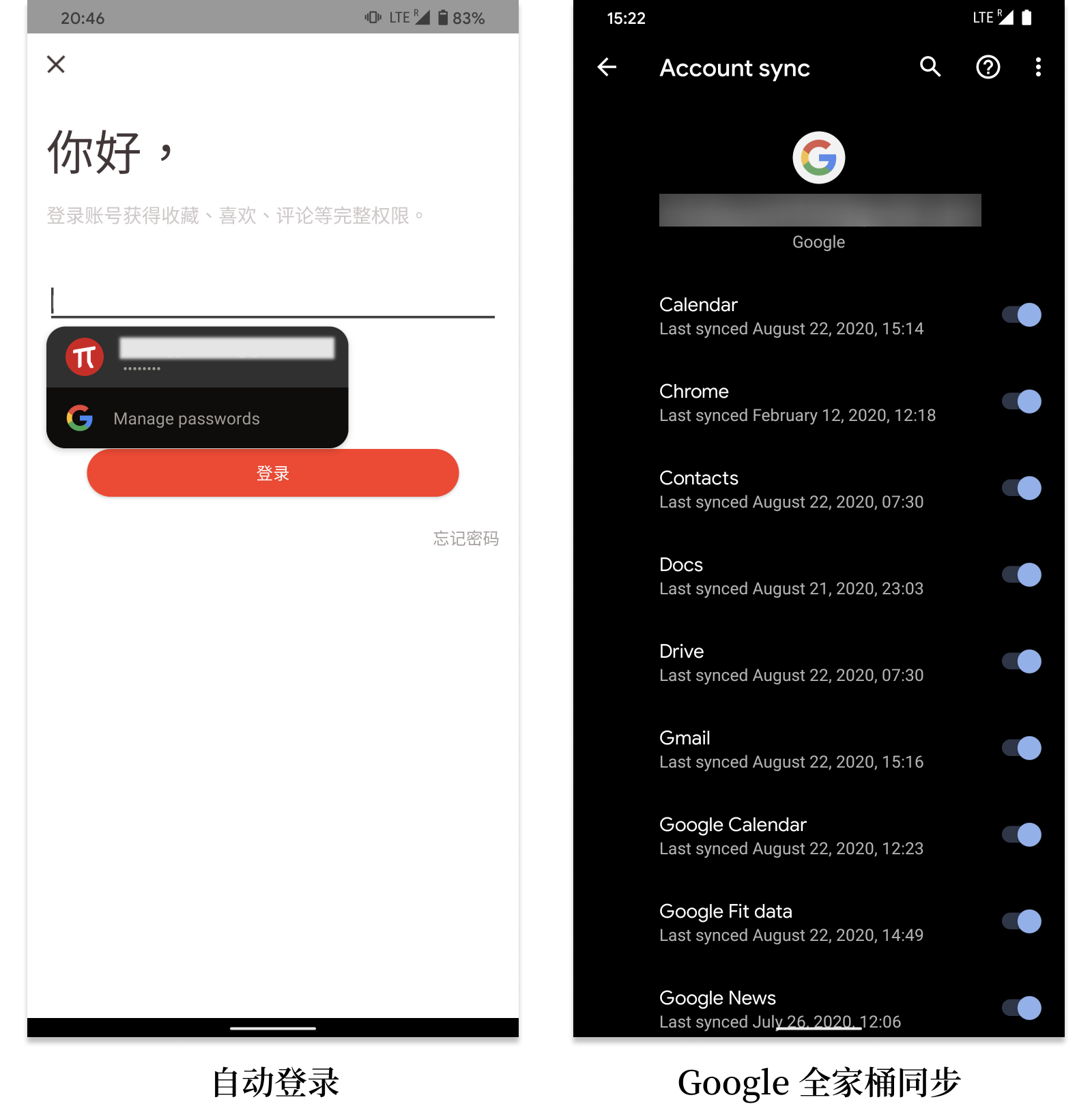

因为自己此前在「Apple 全家桶」中也一直在使用 Google 服务,平日里我在 iPhone X 和 Pixel 4 XL 两台手机间来回切换的过程中也没有任何不适。登录了 Google 账号后,自家的日历、Chrome 浏览器数据、通讯录、YouTube、Gmail 邮箱、Keep 笔记、地图乃至 Google Photos 等应用和数据都实现了自动同步,配合 Chrome 与 Android 通用的自动填写框架,第三方 App 也无需手动输入账号密码,Google Smart Lock 还会调取储存在 Chrome 中的密码数据进行自动登录。

相比于 iCloud,Google 账号的同步服务在跨平台的应用场景中兼容性更好,会更让人感受到数据互通的便利。

操作方式上,在全面屏普及的趋势之下,Android 屏幕底部的小横条取代了原来的三大金刚,操作方式同样为上划返回桌面、上划并停留开启多任务切换界面、左右滑动切换 App,并且在桌面任意位置下滑可呼出通知中心,任意位置上划可呼出 App Drawer 应用抽屉3

,两侧屏幕边缘划动则可返回上一层级,配合体验不输 Taptic Engine 的线性马达,系统导航的交互体验与 iPhone 大同小异。

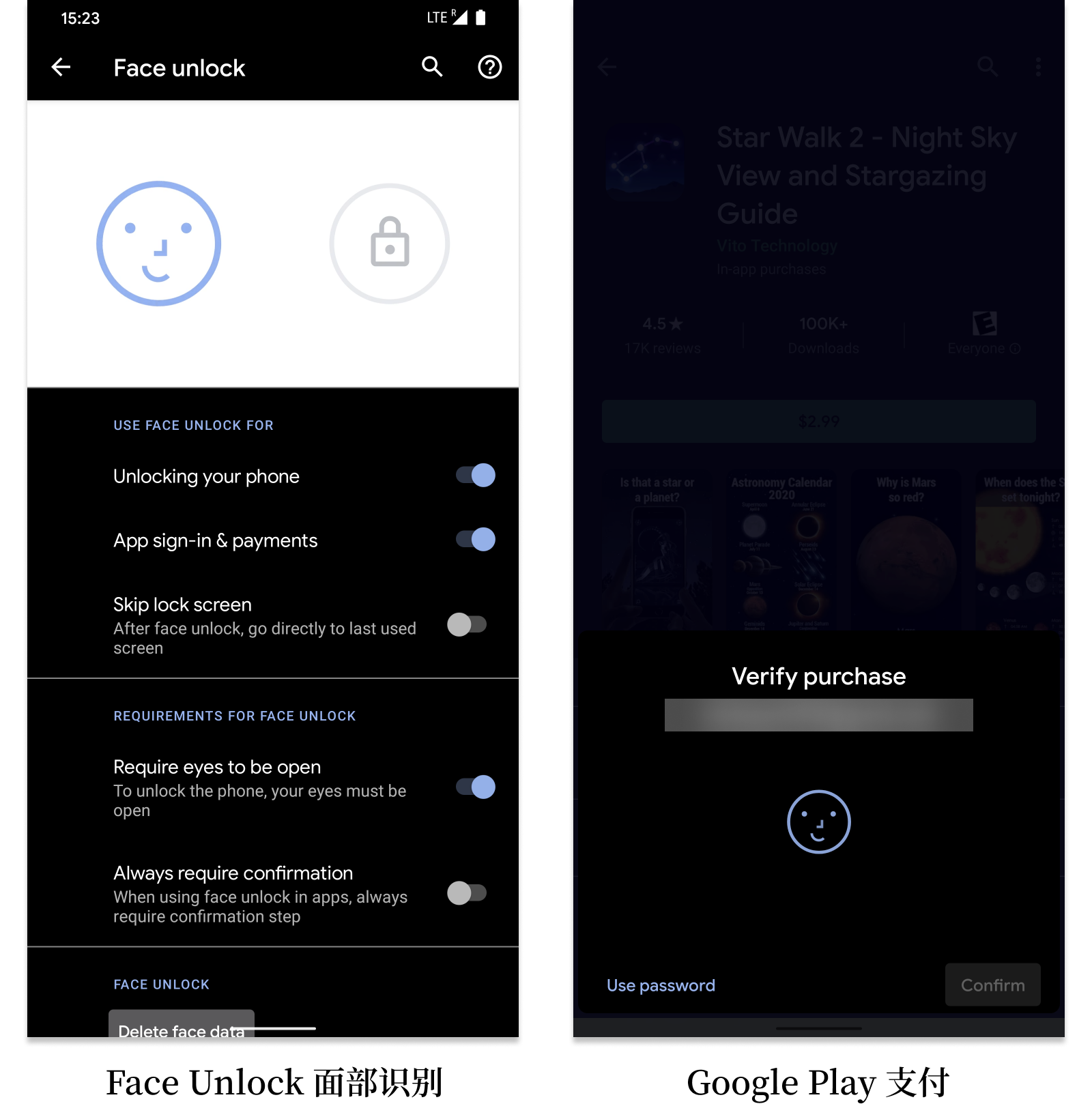

作为首款使用面部识别替代指纹识别的 Pixel 手机,Pixel 4 XL 采用了与全面屏 iPhone 的 Face ID 类似的识别原理,通过红外摄像头发射一系列点状射线,来对面部进行 3D 建模。因此它也同样具有极高的安全性和极快的识别速度,可在任何光照环境下工作。

比较遗憾的是,由于 Google 对于应用开发商的号召力与控制力均不如 Apple,其面部解锁目前的应用范围仍十分有限,除了被用来进行屏幕解锁、Google Pay/Play 支付外,只能在为数不多的已适配 App 中用于身份验证或支付。

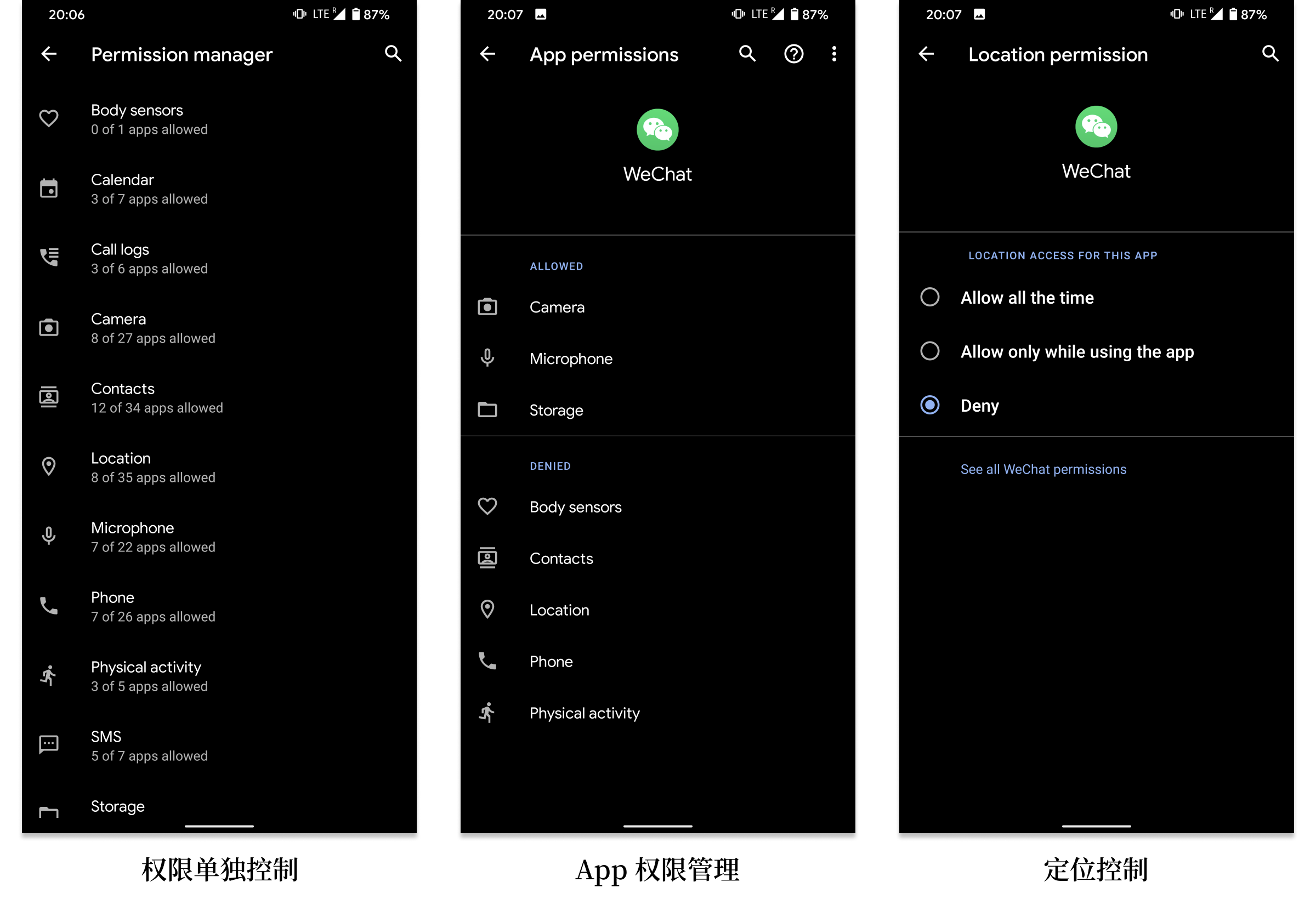

软件体验方面,由于 Android 系统的开放性,App 不规范行为一直可以说是乱象丛生。好在到了 Android 10,原本饱受诟病的权限管理功能总算快赶上 iOS 了,内置的 Permission Manager 可以实现对各种细分权限的单独控制以及对单个 App 的权限控制,对于 GPS 定位权限也增加了「只在使用 App 时允许」这一选项。

出于个人的「应用洁癖」,我所有 App 均从 Google Play Store 下载安装,但还是在使用过程中,碰到了某证券类 App 不给电话权限就无法正常打开使用的情况,只能说希望未来 Android 能继续提升权限管理的严格程度,像 iOS 那样强力压制毒瘤类 App。

相较于一些厂商的手机在 Android 11 即将正式发布之时才用上 Android 10 的悲惨情形,及时的系统更新则一直是 Pixel 作为 Google「亲儿子」的最大优势。Pixel 的系统更新可以分为三类:

- 例行安全更新:在每月月初的第一个周一(北京时间周二凌晨)推送,主要作用是为系统安装安全补丁;

- Feature Drop(功能投放):每三个月左右推送一次,其包含了部分系统功能的更新与改进,比如上一次的 Feature Drop 为 Pixel 4 增添了新的 Motion Sense 手势、自动深色主题切换、面部解锁时的闭眼检测等功能;

- 年度大版本更新:每年第三季度推送,Pixel 可以提前约半年获取、使用,通过开发者预览版、测试版等方式进行尝鲜。

因此随着使用时间的累积,Pixel 4 XL 的「硬件配置」这个概念在我的感知中其实也在逐渐淡化,比起思考处理器是什么型号、运行内存有多大、镜头参数是多少,我更关心哪些应用适配了新特性、接下来会推送哪些新功能、下一个版本的 Android 操作系统何时到来……

并不是说 Pixel 4 系列的硬件配置不够出色,只是「上手即用」的吸引力远胜于「配置参数顶天」,这倒与我之前选择 iPhone 的理由有些类似。

手机是「环境」的一部分

硬件参数加上软件体验构成了一部智能手机,而对当代人来说,手机更常常被看作是连接自己与互联网世界的桥梁。

但坚持「环境计算(Ambient Computing)」理念的 Google 可能不是这么想的——比起让手机成为我们连接世界的外延,Google 更希望手机能直接融入到我们所处的环境中去。

这里所说的环境计算其实也是近年来在硅谷科技公司中日趋流行的热词之一,它指的是通过技术手段(例如动作追踪、语音识别、手势控制、人工智能等等),让电子设备更深层次地融入周围环境,以至于人们在与电子设备进行交互时完全不会意识到他们此刻正在使用这些设备。

Our vision for ambient computing is to create a single, consistent experience at home, at work or on the go, whenever you need it. —— Rick Osterloh, Google Senior VP of Devices&Services

Google 在环境计算方面的努力,就包括了 Pixel 手机(以及 Pixel Buds 耳机)、Nest Home 家居系列产品以及附带的 Android Auto 车载助手等一系列产品在内的软硬件服务,用 Google 硬件主管 Rick Osterloh 的话来说,Google 有关环境计算的愿景是让用户不论在家中、在工作场合或是在路途中都可以随时随地便捷地获取 Google 服务,使得 Google 服务成为用户可信赖的必需生活品一般悄无声息地融入周围环境。

设备之于用户,就像自来水之于人类,在整个生态系统中,你我才是中心。

(图源:stratechery.com)

这种理念放在 Pixel 4 这里,便是 Google 为这部手机加入的 Soli 雷达芯片/Motion Sense 技术以及反应更快、更聪明的新版 Google Assistant 语音助手。

无接触的感知、预测与执行

挥手、拨动甚至只是轻轻将手伸出尝试靠近,这些我们日常生活中常见的动作,在 Pixel 4 上则可以用来接/挂电话、操控闹钟/定时器、切歌或是控制播放/暂停。

把手势映射为直观、符合直觉的交互操作,发布 10 个月后的今天听上去依然很酷,实际使用的过程中它也并非只是一个「噱头」——如果你也喜欢在下厨、洗澡或埋头睡觉的过程中将手机放在附近,应该能明白我在说什么。

作为 Google 研发多年的 Project Soli 项目在消费电子产品上的首次应用,Soli 雷达与 Motion Sense 技术的意义并不单纯地只是增加了一种与手机软硬件交互的新方式,它让我们手中的智能手机拥有了另一种维度的感知能力:周围所发生的细微动作、乃至蝴蝶翅膀的振动,Pixel 4 都能通过「额头」上这块指甲盖大小的芯片感知到。

就像发布会上所宣传的那样,Motion Sense 开启后,Soli 雷达会在手机上方的小范围内生成一个半球形的区域,一旦感知到用户靠近或是离开时,手机都可以紧接着作出相应的预测并执行对应的操作。比如当来电铃声或是闹钟响起时,若我试图伸手去拿 Pixel,它便会立刻感知我的动作而将音量调低,之后我可以左右挥手让铃声静音;将 Pixel 放在桌上并离开后,它会自动关闭屏幕的长亮显示(Always-on Display)功能以达到省电的目的。

而在我的实际使用过程中,Motion Sense 在其他微小之处所发挥的作用也能时时提醒我它与其它智能手机的不同,比如当我靠近 Pixel 试图拿起它时,Soli 雷达会马上唤醒 Face Unlock 的传感器并以较低的亮度点亮屏幕,这样当我拿起它的同时它便会立刻对我进行人脸识别认证,进一步加快了手机解锁的速度。如果你像我一样开启了「人脸解锁后跳过锁屏界面」的开关,人脸识别解锁手机的速度会更快,真正实现「拿起即用」的效果

另外,当我将 Pixel 的桌面设置为内置的宝可梦动态壁纸时,对着手机挥挥手,它也会朝你挥手,让我感觉仿佛在手机里养了一只宝可梦。这算是一个聊胜于无的休闲小功能。

经过几次更新修复和功能投放,Motion Sense 的使用场景依然有限,但可靠性和刚发布时相比已经有了较大程度的提升。这种提升是增加一个额外硬件(Soli 雷达)、牺牲屏占比换来的,是否值得见仁见智。

但类似 Apple 为 iOS 加入的 3D Touch 而引入了第三个维度的交互操作一样,Motion Sense 同样也为人与手机软硬件的交互带来了一种新的可能性,如果 Google 能够坚持优化并逐步开放 Motion Sense API,开发者一定能为这种新的交互方式带来更多精彩。

可惜并没有,这个我们后面再说。

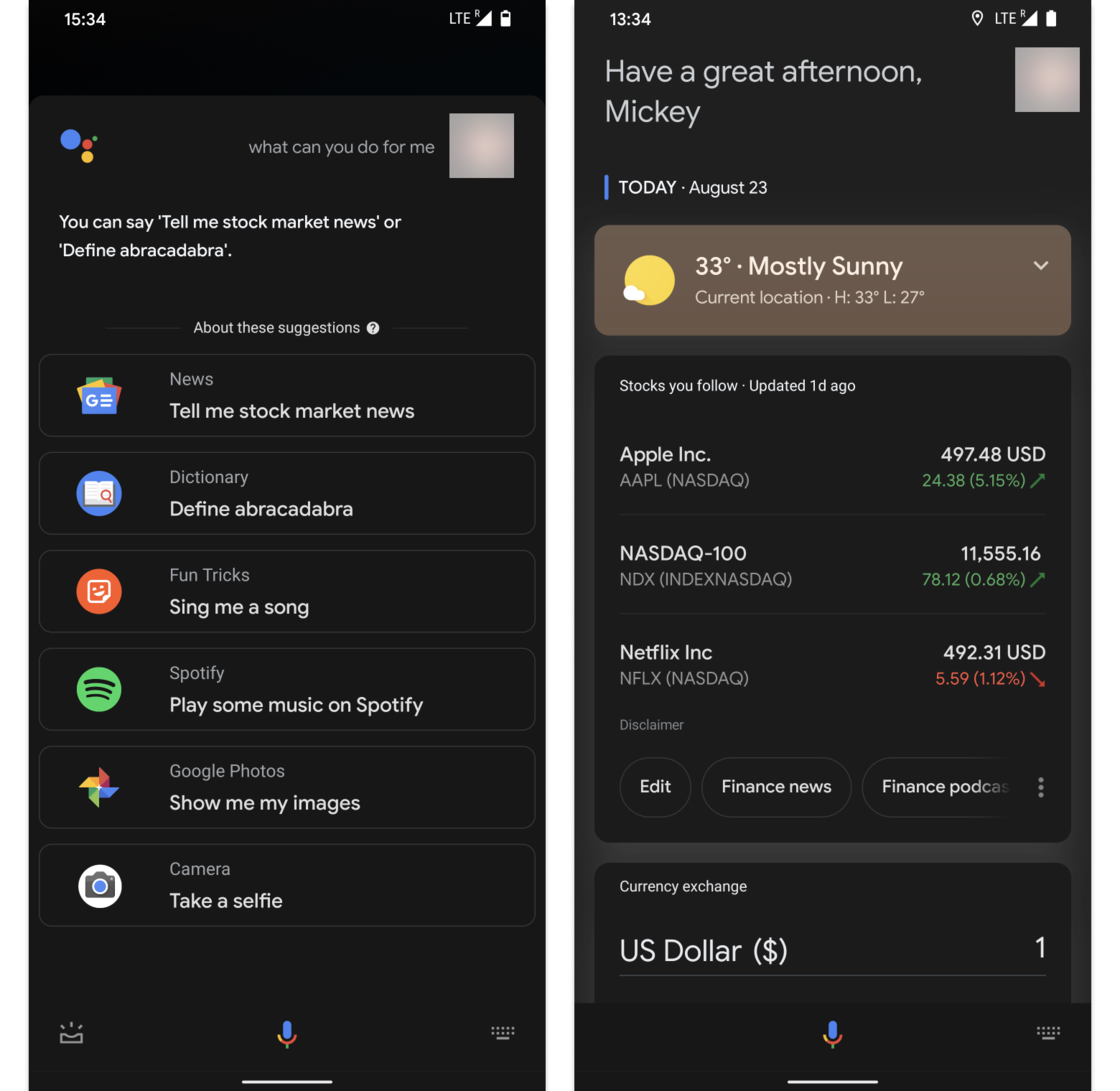

真正扎根于系统的智能助理

早晨起床,睁开惺忪的睡眼,一句「Hey Google, good morning」,你便能听到今天的天气、行事历、提醒事项、睡眠期间国际证券市场的行情信息、晨间新闻或播客;打开车门坐上车,手机与车机自动连接并开启地图显示了当前抵达公司的最快导航路线与拥挤程度,在到达公司停车位后自动在地图上标记了停车地点;下班后走上车,车机提示了回家的最快导航路线,对话的间隙就点好了外卖,到家便能吃上热乎的晚餐;睡前躺上床,一句「Hey Google, good night」,房间内的灯光逐渐熄灭,同时自动响起了轻柔的助眠曲。

以上的场景,对于十年前的人来说可能只存在于科幻片中,时至今日,因为 Google Assistant 的存在,这一切都变成了可以握在手里的现实。

过去几年,手机的语音助手更像是系统自带的一件附属品,我们通常只能通过与其对话来咨询需要的一些网上的信息,或是无聊时听其讲笑话来逗趣,甚至时常还会闹出一些笑话,让用户感叹「AI 不是人工智能,而是人工智障」。

而 Pixel 4 所搭载的新版 Google Assistant 却不再是一个可有可无的角色,通过将原本存储在云端的、体积巨大的机器学习模型转移到本地,它第一次做到了根植于 Andriod 系统的每一个角落,以更加快速、灵敏的方式回应我们的每一次询问、每一个命令。

这就导致和「使用各种方式呼出 > 询问 > 等待语音识别 > 等待返回结果」这整个流程相比,新版 Google Assistant 直接将前三个环节浓缩成了一个。即问、即答,在不需要担心它听不懂我们在说什么的优秀体验之下,我们要做的只是「表达想法」,比如:

帮我找找去年 8 月拍的宠物照片。

随即 Google Photos 便启动为我们呈上结果。

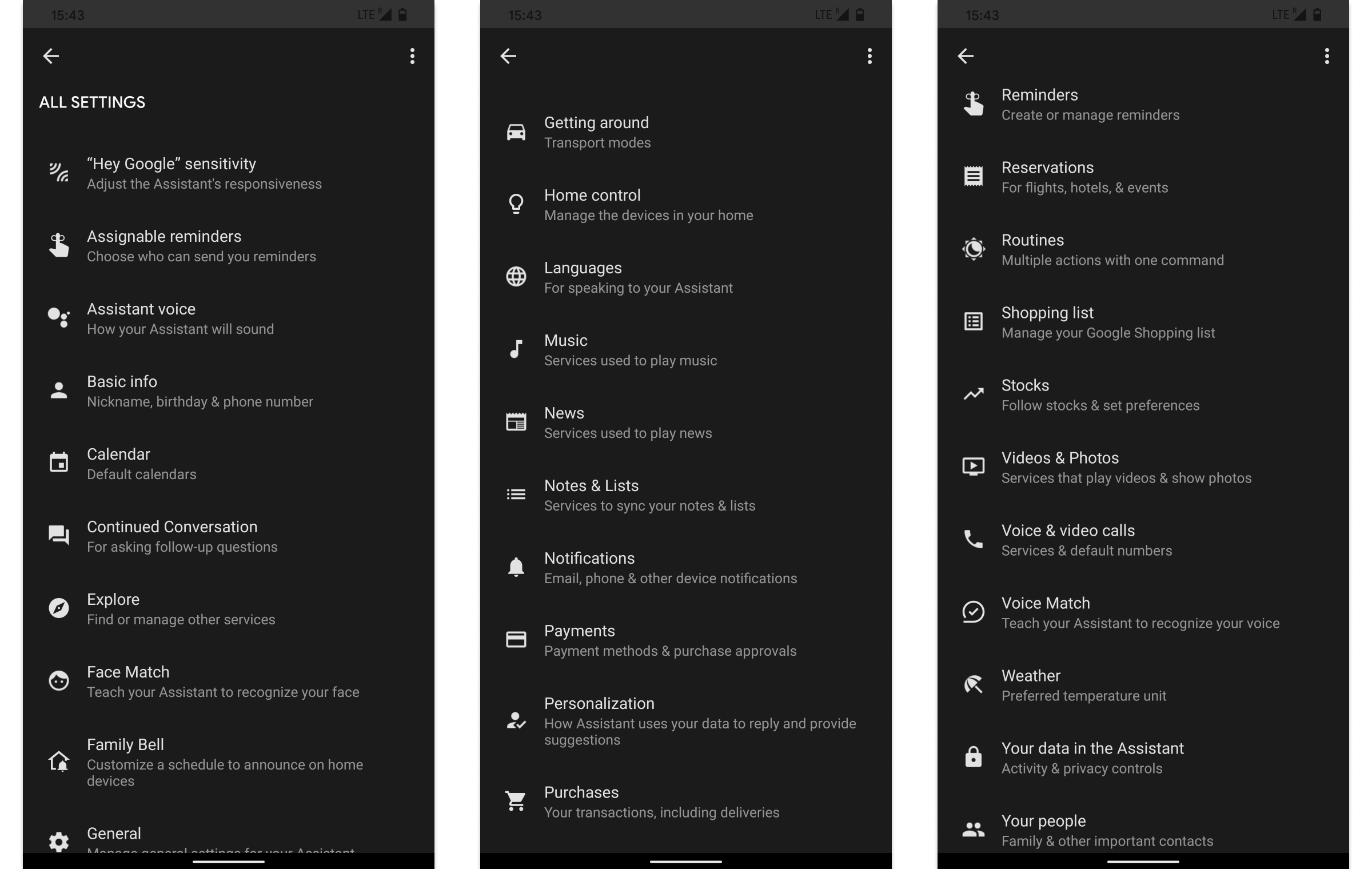

其它功能方面 Google Assistant 的水准也不愧是当前一流水平的智能助理了。从下图中的设置菜单便可看出,Google Assistant 能替我们完成的事情覆盖了日常生活的方方面面,包括告知天气、设定日历事件、设定提醒、提示出行路线与耗时、控制智能家居、播放音乐或播客、播报新闻或股市行情、创建笔记或清单、预订机票酒店、点外卖、购买电影票,甚至是接打电话等等。

设备形态上,它则不仅仅局限于手机,在 Google Home 音响、Google Nest 智能家居、汽车车机上的 Android Auto 中都有它的身影。

这种跨设备、多功能的布局形态所搭建出来的最终结果,就是作为用户,我只需要在「想要完成某件事」的时候告诉 Google Assistant 自己的想法。

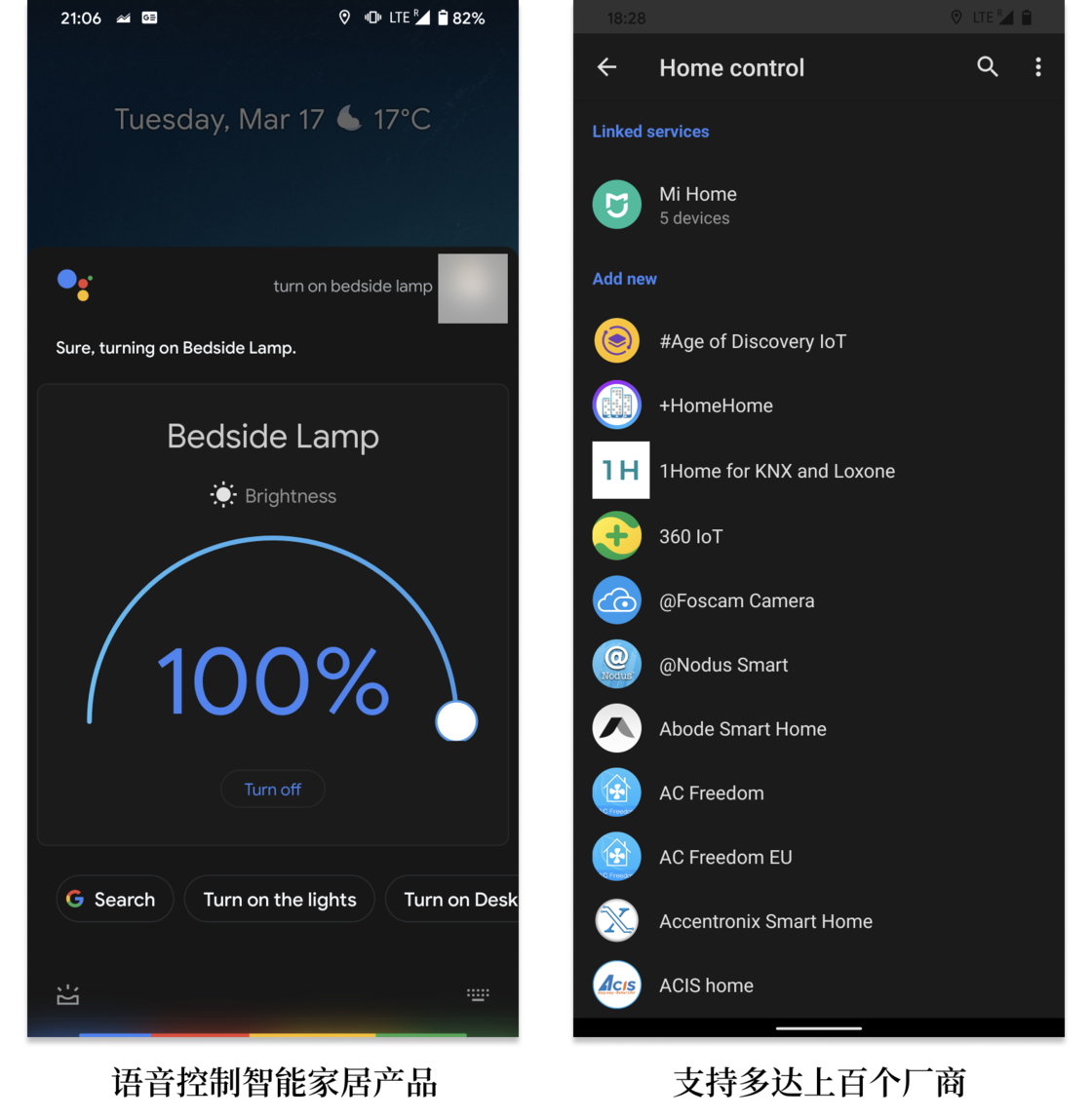

当然了,以上大多数功能目前可能都与中国内地用户无缘。在为数不多的可用功能中,智能家居控制可以多说一点:通过 Google Assistant,我们可以语音控制米家及其生态链的一些智能家居产品,比如台灯、床头灯、多彩灯带、空气净化器等等,同时也支持设定一系列的家居智能场景,通过设定时间、地理位置、前置条件等,一旦触发便执行各场景的开关操作。

另外,除了 Google Assistant,Google 的传统艺能 AI,在 Android 系统中也是无处不在,比如:

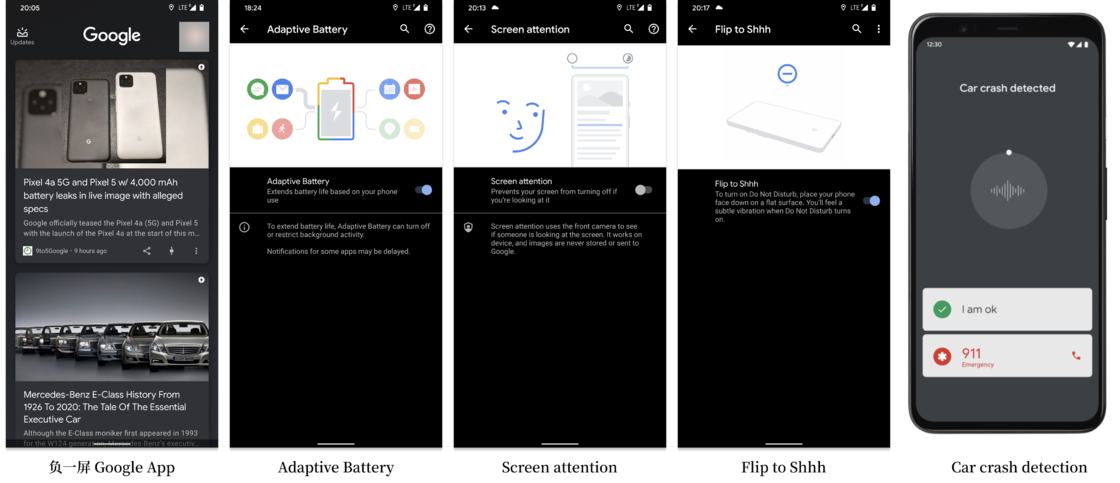

- Google App(负一屏浏览):在手机桌面左划,会看到 Google App 呈现的负一屏,系统会根据用户日常浏览的内容通过算法将用户可能感兴趣的资讯推送给用户;

- Adaptive Battery(适应性电池): 通过记录用户的日常使用习惯,系统会通过建立一套模型来预测用户接下来会或不会使用何种 App、何时会给手机充电,从而为不同的 App 分配不同的电量模式,以延长电池使用寿命;

- Screen Attention(屏幕注意力): 当用户注视着屏幕时,系统将不会关闭屏幕显示,即使当前亮屏事件已经超过了预设的息屏时间。这项功能配合 Motion Sense 在上述下厨场景中更加好用;

- Flip to Shhh(翻转手机开启勿扰模式):如果有需要,只需屏幕朝下翻转手机放在桌面上即可开启勿扰模式,从而避开外界纷扰、专注手头事,重新拿起手机则会从勿扰模式恢复,此时手机还会给出一个非常微妙的振动提醒。

即问即答的 Google Assistant 配合无处不在的 AI 算法,Pixel 4 无时无刻都在学习、感知我的使用习惯。所以当我们回头再去审视 Google 提出的那个让用户在任何需要协助的时候都能「Instantly get what they need」的构想时,我觉得 Pixel 4 是做到了的。

最让人安心的拍照体验

聊完环境计算,接下来便是 Pixel 手机绕不开的一个话题——相机。

相信不少人对 Pixel 3「一颗镜头秒全场」的美誉仍记忆犹新,依托 Google 强大、傲人的计算摄影算法,Pixel 3 单摄像头拍照产出照片的成像效果可以秒杀同期大多数配备双摄的手机,可谓一枝独秀。

随着技术演进,配备三摄、四摄的手机陆续发布,Google 也为 Pixel 4 系列增加了一颗长焦双倍望远镜头,让它的拍照能力更上一层楼。有些令人困惑的是,Pixel 4 只有两颗后置镜头,却也将背面的镜头模组设计成了与部分三摄/四摄手机的镜头模组一样的浴霸造型。不过相比于 iPhone 11 Pro 那样面目狰狞的浴霸造型,Pixel 4 全黑的设计在我看来还是协调、美观许多。

说回拍照。个人认为,手机的拍摄功能对于多数人而言最大的意义,就在于拿起即拍,并得到一张画质不算顶级但也十分不错的照片,而非像专业摄影师那样按下快门前手动调节参数,拍好后继续做后期调整。

简而言之,「拍到」比「拍好」更加重要,而 Pixel 4 在这一点上就做得非常好,在大多数场景之下,我所要做的就是举起手机、按下快门,「咔嚓」一下我就能得到一张满意的好照片。如 Google 广告语所说:

Studio‑like photos.Without the studio.

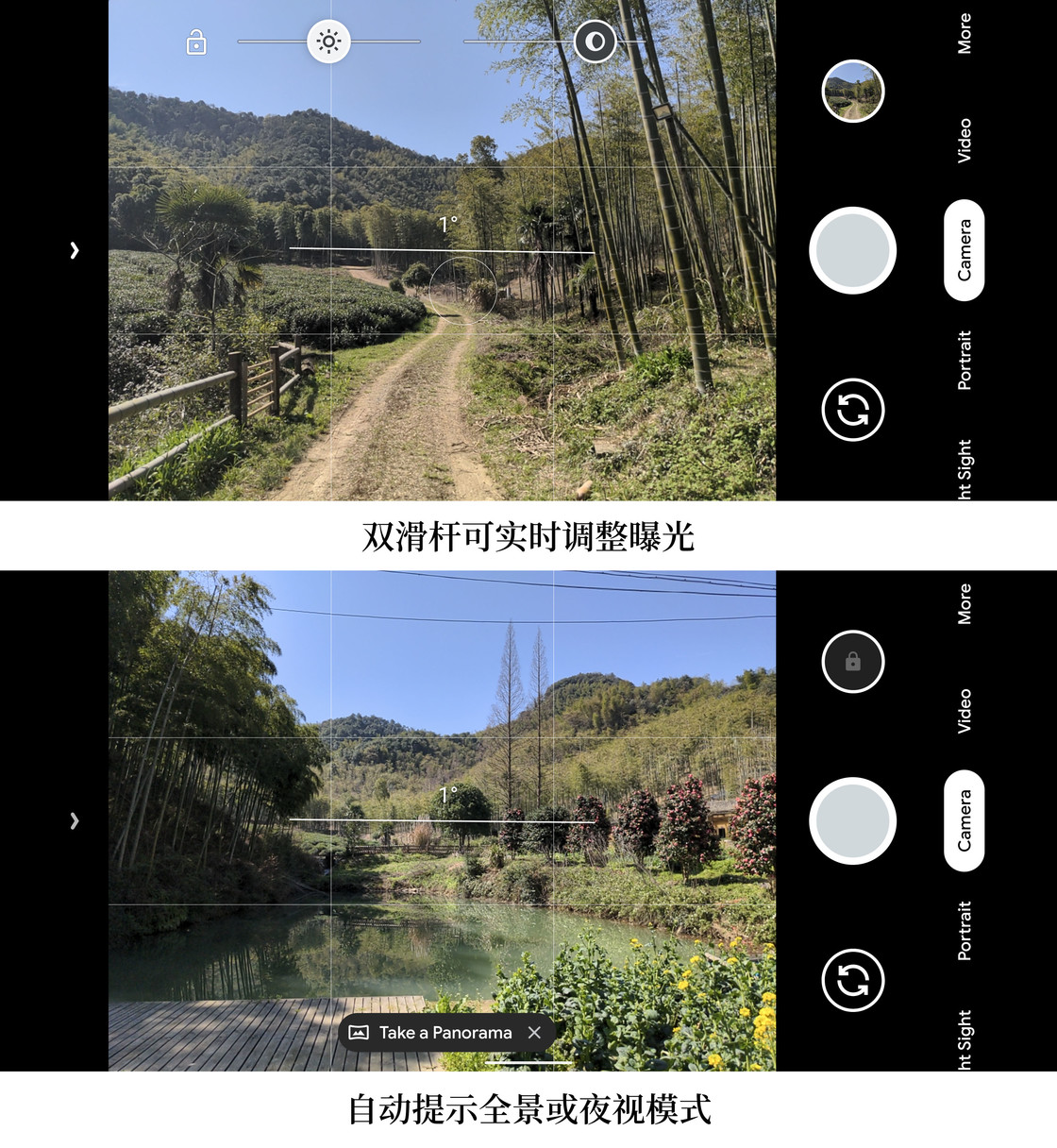

在这个杀手锏背后,Google 强大的计算摄影算法可以说是 Pixel 拍照的灵魂。在新版本的 Google Camera 中,对于相机正在拍摄的画面,算法会在后台进行实时预判,比如在镜头对着风景画面时系统会提示是否切换至全景模式,镜头对着较黑的夜间画面时系统会提示是否开启夜视模式(Night Sight)。

如果你对当前的画面中物体的亮暗部分配不满意,单击画面任一处还可以调出两条滑杆,可分别对亮度和暗部光线进行实时调整和查看,从而直接在取景的同时调整画面曝光。

第二颗长焦镜头的加入,对人像模式的成像效果也是一大 Buff,近物拍摄中有了更多的景深和更好的前后景分离效果。以下图的对比为例,iPhone X 对于近物的识别处理还是不太乐观,树干年轮的两侧以及边缘都被当作远物进行了虚化而显得很奇怪,而 Pixel 的样张效果则好很多,近物及其边缘都处理得不错且比较锐利,不在电脑上放大仔细看的话,几乎可以媲美无反相机加大光圈镜头的拍摄效果(以下照片样张均无后期)。

而在两部手机拍摄的远摄放大相片中,似乎差距就不大了,八倍的放大倍率下,Pixel 样张中的文字比 iPhone 样张稍微清晰一点点,英文部分可勉强被识别,iPhone 样张中的英文部分无法辨认。

要说给我印象最深刻的,那自然还是 Pixel 4 的夜视模式(Night Sight)了。在夜视模式下,通常需要在按下快门后保持 2 秒左右的静止,此时 Pixel 会重复拍摄多张照片并进行算法合成,夜拍成像效果清晰、明亮,噪点也控制得十分得当。在第二张维多利亚山顶拍摄的照片中,可以看到在明暗分布较为复杂的环境中,Pixel 不仅把近处较暗的居民楼、中远处较亮的商业楼与对岸的楼房都区分呈现得较为清晰,同时也让黑暗的天空中肉眼无法直接分辨的云层一览无余。可以说即使在光线条件十分差劲的黑夜中,Pixel 也能直出效果优异的照片,无需后期便可与朋友分享,简直就是个夜视仪。

在怪兽大厦下找到了经典视角后,我又用索尼的老一代无反旗舰相机 A7R2 和 Pixel 做了个对比,Pixel 的表现依然惊艳,照片中各个楼层窗户的暗部细节都可以清晰地显示,天空部分的噪点控制优秀,甚至还在光污染非常严重的香港港岛拍到了星星,使我不由得直呼「Google 大法好」。

至于传说中可以拍银河的天文模式,住在城市中的我就不妄想了,希望未来能有机会去感受一下它的魅力。

总的来说,拍照成像在 Pixel 4 上得到了进一步的强化,在成像色彩、夜拍等各种场景中都非常强悍,其综合素质依然顶尖,作为用户我只需在想拍照片的时候拿出手机取好景放心拍就是了,别的都不用考虑,即使是摄影小白也能拍出很棒的照片。

在我看来,Pixel 4 在相机上最大的遗憾还是缺少一枚超广角镜头,这意味着它要和那些极具视觉震撼感的风景照 say goodbye,并且在出门游玩想拍景物时我常常需要「后退后退再后退」。也许 Google 在超广角镜头和长焦镜头之间选择了长焦镜头,但这不应该是一个二选一的取舍问题,为何不能像 iPhone 11 Pro 那样超广角与长焦镜头「我全都要」呢?

Pixel 的未来在何方

转眼间,距离 Google 2019 年的年度旗舰 Pixel 4 系列新机发布已经过去了 10 个月,其「附属」产品线 Pixel 4a 也于不久前面市并获得了不少好评。

和价格看上去更加合理的 a 系列产品相比,以往 Pixel 旗舰系列的推出总会引出一些争议。Google Pixel 有着 Google「亲儿子」的特殊身份,作为 Android 手机的「标杆」,它的使命似乎是给其他厂商指引一些新的发展方向,告诉大家在 Google 眼里的 Android 设备究竟应该是什么样子。

尤其是在现在这个时间节点上,竞争对手们都卯足了劲在奋力追赶,优化算法的同时相继配备了大底、高像素、超广角这些特性,Pixel 在相机成像方面与竞争对手间的差距却变得越来越小。如果 Pixel 在算法上不能持续地保持其巨大的竞争优势,我想继续增强一下它稍显落后的镜头硬件配置不失为一个可行的策略。

遗憾的是,根据目前披露的信息来看,Pixel 5 的主相机镜头大概率仍会继续沿用与 Pixel 4 系列相同的、自 2016 年 Pixel 2 时代就在用的传感器,并且仍不会添加新镜头,而是会以一颗超广角镜头来代替长焦镜头。

所以对于 Pixel 系列的忧虑甚至笼罩着 Google Pixel 系列一直以来引以为傲的影像表现领域——前不久,Pixel 相机团队负责人同时也是计算摄影领域的大牛、Pixel 影像成就的功臣 Marc Levoy 离职跳槽去了 Adobe,再加上目前根据传言披露的信息显示下一代 Pixel 5 将沿用 Pixel 4 的机身模具、采用高通骁龙 7 系而非旗舰级的 8 系处理器、为了全面屏而砍掉了颇具探索性意义的 Soli 雷达与面部识别模组、主相机传感器仍保持不变且不会新增第三颗镜头,这些都预示着 Pixel 系列手机的产品设计考量将从「体验优先」变为「成本优先」,其地位也将从旗舰级别降级为次旗舰,甚至是中端机。

下一代 Pixel 不由得让人疑虑:

未来的 Pixel 旗舰将走向何方?

作为一个和 Pixel 4 XL 相处了 10 个月的用户,面对这样的未来我也没有答案。如果以上的消息为真,那么在目前的 Pixel 4/4XL、Pixel 4a 以及即将发布的 Pixel 5、Pixel 4a 5G 这几代设备中,Pixel 4 系列的地位将变得十分特殊,甚至可以说 Pixel 4 系列是整个 Pixel 产品线中的巅峰与代表之作。

换句话说,Pixel 4 系列的身份越来越像是一个「末代旗舰」了,至于这位对 Android 生态而言一直有着先锋、开创甚至引领意义的「亲儿子」何时会回归,我想可能得等到 Google 自研芯片走向成熟的那一天吧。